Além do padrão: reflexões sobre IA e inteligência humana

Introdução

Em Quando Máquinas Aprendem Demais: Notas sobre Singularidade e Superinteligência, Silvio Meira desenvolve uma análise sobre inteligência artificial (IA), tendo como inspiração a releitura do artigo On the Measure of Intelligence (2019) de Chollet. Partindo do artigo Attention is All You Need (2017), que introduziu a arquitetura transformer para modelos de IA, Meira examina os debates atuais sobre Inteligência Artificial Geral (AGI), superinteligência e singularidade.

AGI refere-se a um sistema de IA hipotético que transcende os limites dos sistemas atuais, especializados em tarefas específicas. Um sistema AGI seria capaz de realizar qualquer tarefa intelectual que um ser humano possa executar, incluindo aprender, raciocinar, planejar e adaptar-se a novas situações. Este conceito está intrinsecamente ligado à noção de superinteligência — um sistema que ultrapassaria significativamente as capacidades cognitivas humanas em praticamente todos os domínios relevantes.

A convergência destes conceitos culmina na ideia da singularidade tecnológica, popularizada por Kurzweil em A Singularidade está próxima (2005). Este termo descreve um momento hipotético em que uma IA superinteligente iniciaria um ciclo de autoaperfeiçoamento recursivo, desencadeando mudanças tecnológicas e sociais tão profundas que se tornariam impossíveis de prever ou compreender — daí a analogia com o horizonte de eventos de um buraco negro.

É neste contexto conceitual que Meira desenvolve sua análise, entrelaçando as visões pioneiras de Turing, Good e Vinge com as discussões contemporâneas sobre alinhamento e controle de IAs. O alinhamento, no contexto da IA, refere-se ao desafio fundamental de garantir que sistemas de inteligência artificial ajam de acordo com os valores e objetivos humanos: não apenas seguindo regras programadas, mas compreendendo e internalizando princípios éticos e morais que norteiam o comportamento humano. Esta questão torna-se particularmente crítica quando consideramos sistemas cada vez mais autônomos e capazes, levantando dúvidas fundamentais sobre a própria possibilidade de alinhar verdadeiramente uma inteligência artificial com valores humanos.

São precisamente estas dúvidas que o texto de Meira explora com profundidade. Em uma abordagem interdisciplinar que incorpora perspectivas da computação, filosofia e ciências cognitivas, ele fundamenta sua análise em definições precisas de inteligência — tanto humana quanto artificial — e examina possíveis cenários pós-singularidade, abordando questões críticas sobre o futuro da interação entre humanos e sistemas de IA. O resultado é uma análise extraordinariamente rica e sistemática que estabelece paralelos entre o desenvolvimento tecnológico e ética, como autonomia, consciência e responsabilidade.

A leitura do texto suscitou-me algumas reflexões, que ouso colocar no papel, sob o “imenso risco” de soar ingênuo diante da complexidade do tema e da distância entre o profundo conhecimento do autor e minha perspectiva amadora como um entusiasta usuário de ferramentas de IA.1

Da estatística à compreensão: como funciona um modelo transformer?

A arquitetura transformer revolucionou o processamento de linguagem através do mecanismo de “auto-atenção”. Diferentemente de modelos anteriores que processavam texto sequencialmente (palavra por palavra), o transformer analisa todas as palavras simultaneamente, pesando suas relações mútuas. Para compreender como este processamento funciona — e suas limitações fundamentais — podemos usar duas analogias complementares.

Primeiro, imagine uma reunião em que cada participante pode dialogar simultaneamente com todos os outros: cada um pode fazer perguntas (queries), cada um tem expertise em certos assuntos (keys), e cada um contribui com informações (values) para a compreensão coletiva. Da mesma forma, no processamento de linguagem, cada palavra em uma frase interage simultaneamente com todas as outras, estabelecendo conexões de relevância.

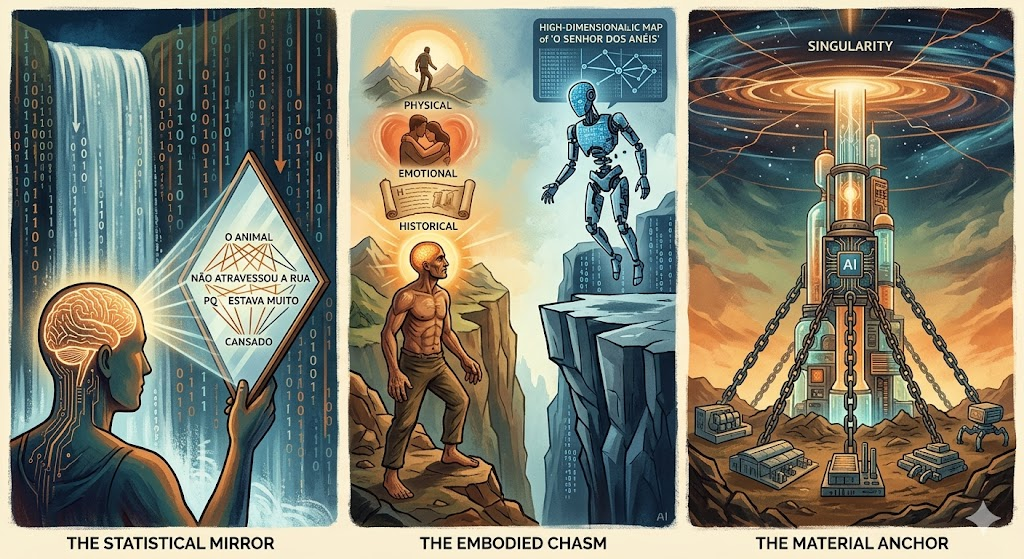

Tecnicamente, isto se implementa como uma rede onde cada palavra está conectada a todas as outras por “linhas de força” invisíveis: quanto mais forte a conexão estatística entre duas palavras, mais forte a linha. O modelo constrói várias dessas redes em paralelo, cada uma captando diferentes tipos de relações (sintáticas, semânticas, temáticas). Considere a frase “O animal não atravessou a rua porque estava muito cansado”: ao processar a palavra “estava”, o modelo atribui pontuações de atenção mais altas para palavras relevantes (especialmente “animal”) e mais baixas para palavras menos relevantes (“rua”, “atravessou”), estabelecendo assim a conexão correta entre “estava” e seu referente.

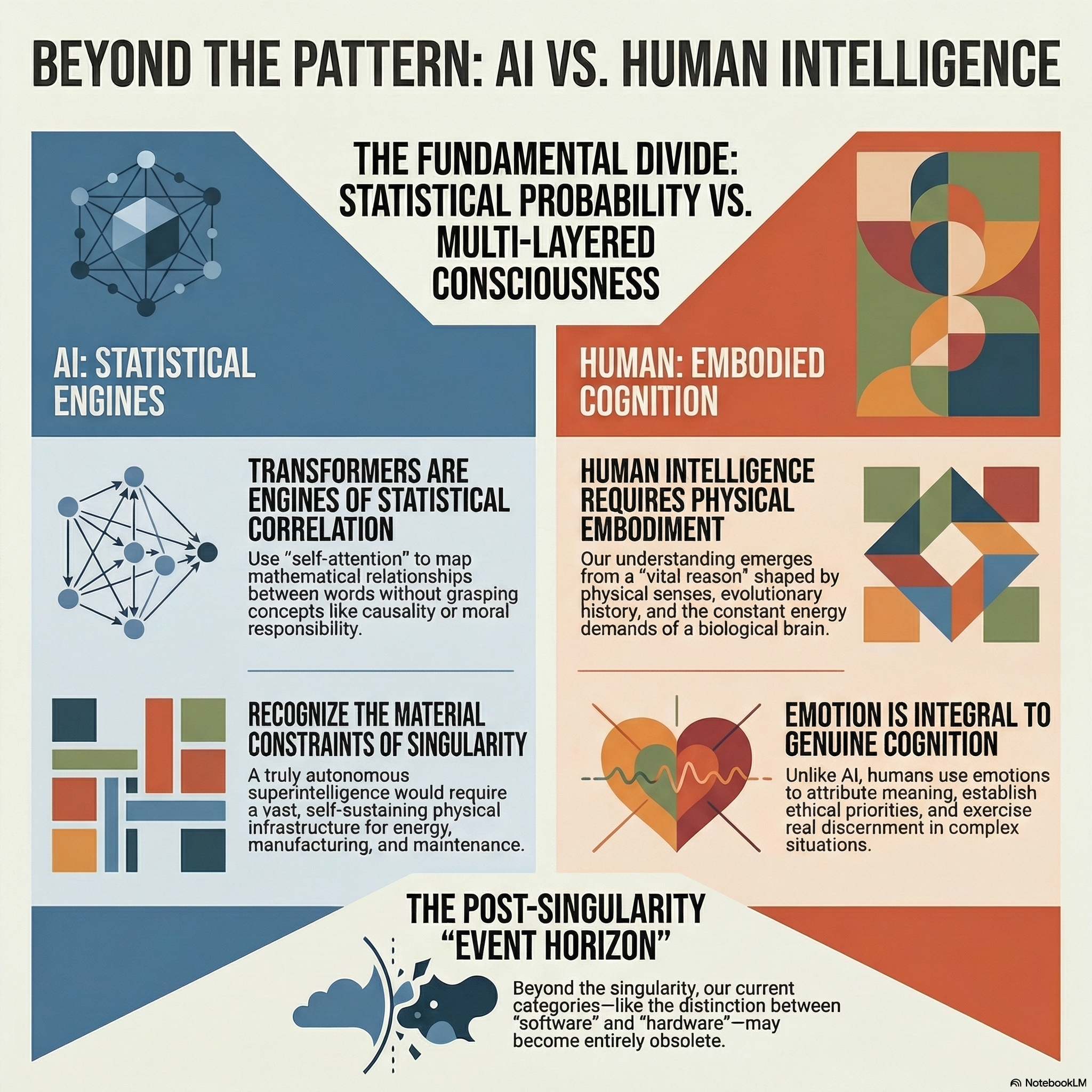

Os transformers se tornaram a base dos modernos modelos de linguagem como ChatGPT justamente por sua capacidade de processar texto de forma não-sequencial e capturar relações complexas entre palavras distantes através de múltiplas “camadas de atenção” paralelas. Ou seja, este processamento massivamente paralelo de essencialmente correlações estatísticas constitui a base do que chamamos de “compreensão” dos modelos de IA — um termo que, como veremos, pode ser enganoso.

Para ilustrar a diferença fundamental entre processamento estatístico e compreensão genuína, consideremos como diferentes tipos de inteligência processam uma obra literária complexa: O Senhor dos Anéis (1954–55), de Tolkien. Esta comparação nos permite examinar não apenas as capacidades, mas também as limitações inerentes aos sistemas baseados puramente em estatística. Quando um modelo transformer encontra uma frase como “Frodo herdou o anel de Bilbo”, ele não processa a informação de forma linear ou narrativa, como faria um leitor humano. Em vez disso, ele mapeia esta informação em um espaço multidimensional de probabilidades, estabelecendo correlações com outros padrões textuais similares que encontrou em seus dados de treinamento. O modelo não compreende verdadeiramente conceitos como herança, responsabilidade ou relações familiares — ele apenas identifica e reproduz padrões estatísticos associados a estes conceitos.

Em contraste, um leitor humano constrói uma compreensão que engloba: o peso emocional da amizade e do sacrifício; a experiência física e psicológica da jornada; as implicações morais do poder e da corrupção; e o contexto cultural do mito e da lenda.

Esta distinção fundamental entre processamento estatístico e compreensão humana nos leva a questionar não apenas as capacidades atuais dos modelos de IA, mas também os possíveis caminhos para o desenvolvimento de uma compreensão mais profunda e genuína que poderia culminar com uma superinteligência ou a singularidade.

Reflexões sobre inteligência humana vs. inteligência artificial

Da natureza da compreensão

Como podemos pensar a diferença qualitativa entre processamento estatístico e compreensão genuína? Mesmo que modelos transformers possam gerar análises surpreendentemente perspicazes, existe uma diferença fundamental em como eles operam. Enquanto humanos constroem modelos mentais através de experiência corporificada e desenvolvimento evolutivo, sistemas estatísticos, por mais sofisticados que sejam, permanecem fundamentalmente presos a correlações sem causalidade genuína. Quando dizemos que um modelo “compreende” algo, estamos na verdade descrevendo sua capacidade de identificar e reproduzir padrões estatísticos.

A questão se torna ainda mais complexa se considerarmos que o cérebro humano opera com base em padrões estatísticos no nível neuronal — como se fosse um algoritmo genético em execução, cujas linhas de código estão inscritas no ADN. No entanto, a relação entre essas linhas não é linear nem plenamente compreendida. Como nos ensina o filósofo espanhol Ortega y Gasset em sua concepção de “razão vital”, a inteligência humana não pode ser reduzida a um mero processamento lógico, pois emerge da própria vida e de suas circunstâncias concretas. A inteligência é uma propriedade emergente de um sistema complexo; surge não apenas da estrutura subjacente, mas de uma dinâmica probabilística (cuja distribuição desconhecemos), moldada por camadas sobrepostas e interconectadas de interação e adaptação que transcendem o código original.

Esta emergência da inteligência humana resulta de uma interação multifacetada e dinâmica entre diversos elementos fundamentais. Como sintetizado na famosa máxima de Ortega y Gasset, “Eu sou eu e minha circunstância”, nossa inteligência é inseparável do contexto em que se desenvolve. O código genético estabelece a base biológica, definindo predisposições e limitações, mas é a plasticidade sináptica e neuronal que permite ao cérebro adaptar-se continuamente, formando e reforçando conexões ao longo do tempo. A própria capacidade cognitiva depende diretamente de condições materiais básicas: o cérebro, que consome cerca de 20% da energia do corpo mesmo representando apenas 2% de sua massa, requer um suprimento constante de energia — como bem sabe qualquer pessoa que já tentou resolver problemas complexos em estado de fadiga ou privação alimentar. A adaptabilidade neural interage intimamente com nossa experiência corpórea e sensorial, criando um ciclo contínuo de aprendizado através da interação física com o ambiente.

É claro, a base biológica e experiencial não existe isoladamente, mas é profundamente moldada por nossa história evolutiva — processos que selecionaram características cognitivas e comportamentais ao longo de incontáveis gerações. A herança evolutiva, por sua vez, é constantemente modulada pelo ambiente social e cultural em que nos desenvolvemos, com suas normas, valores e linguagens influenciando fundamentalmente nossa forma de pensar e interpretar o mundo. Como afirma Ortega y Gasset em Historia como sistema (1935), “o homem não tem natureza, mas história”. Enfim, todo este complexo sistema é permeado pela consciência subjetiva e emocional, que adiciona as dimensões cruciais de introspecção, autoconsciência e regulação emocional aos nossos processos decisórios.

Reduzir esta intrincada teia de interações a puras relações estatísticas seria como tentar compreender uma sinfonia apenas pela análise matemática de suas ondas sonoras, ignorando o vasto contexto cultural, emocional e histórico que dá significado à música. Esta analogia nos ajuda a entender por que a abordagem fundamentalmente estatística dos modelos atuais de IA tem sido alvo de críticas significativas, como as articuladas por Noam Chomsky, linguista, cientista cognitivo e um dos mais proeminentes tecno-céticos contemporâneos. Chomsky argumenta que estes sistemas funcionam essencialmente como “um motor estatístico de correspondência de padrões”, sem compreensão genuína. Para ele, assim como para outros críticos da abordagem puramente estatística, a capacidade de processar e gerar linguagem convincente não pode ser chamada de “inteligência”, posto que não equivale à verdadeira e intrincada rede de compreensão cognitiva que caracteriza a inteligência humana.

A diferença se torna particularmente evidente quando examinamos obras complexas como O Senhor dos Anéis. Um modelo de IA que “entende” a narrativa está, na realidade, apenas identificando e reproduzindo padrões estatísticos sofisticados em um espaço vetorial de alta dimensão. Por mais impressionante que seja sua capacidade de gerar análises aparentemente perspicazes, o sistema não apreende genuinamente conceitos como sacrifício, amizade ou poder. Em contraste, a compreensão humana da obra emerge de uma interação complexa entre nossa experiência corpórea com conceitos como jornada e sacrifício, nosso desenvolvimento evolutivo que nos permite entender alianças e lealdade, nosso contexto social e cultural que nos ajuda a interpretar poder e corrupção, e nossa consciência subjetiva que nos permite relacionar com as experiências emocionais dos personagens.

Das barreiras conceituais

A compreensão da natureza emergente e multifacetada da inteligência humana nos leva naturalmente a questionar os limites fundamentais dos sistemas baseados puramente em estatística. Se a inteligência humana emerge de uma interação tão complexa entre múltiplas camadas — do código genético à experiência corpórea, da adaptação neural ao contexto evolutivo — que barreiras conceituais poderiam existir para sistemas que operam exclusivamente através de correlações estatísticas? Um sistema poderia ser extraordinariamente eficiente em encontrar padrões e fazer previsões, mas ainda assim ser fundamentalmente incapaz de: desenvolver entendimento causal genuíno; formar modelos abstratos do mundo; ter experiência subjetiva; e exercer agência real (vs. optimização estatística).

A distinção fundamental entre processamento estatístico e compreensão genuína encontra respaldo também na crítica de Chomsky à IA moderna. Segundo o linguista, enquanto a inteligência humana busca criar explicações e compreender princípios subjacentes, os modelos atuais de IA, por mais sofisticados que sejam, carecem desta capacidade explicativa fundamental. Chomsky compara esta abordagem ao behaviorismo, que se concentra em comportamentos observáveis sem compreender os processos cognitivos internos. A crítica é particularmente relevante quando consideramos a incapacidade dos sistemas atuais de desenvolver modelos causais do mundo, mesmo quando apresentam comportamento aparentemente inteligente.

Podemos sintetizar estas limitações conceituais através de uma análise mais profunda do Senhor dos Anéis, que serve como metáfora central para questões de poder, corrupção e escolha moral na obra. Um sistema estatístico pode identificar o Anel como elemento central na narrativa e reconhecer padrões de seu efeito sobre os personagens, mas seria fundamentalmente incapaz de: compreender causalmente o processo de corrupção moral (vs. apenas reconhecer o padrão estatístico de que proximidade com o Anel correlaciona-se com corrupção); formar um modelo abstrato dos conceitos de poder e tentação que transcenda o contexto específico da história (vs. simplesmente identificar padrões textuais similares em outras narrativas); apreender a experiência subjetiva da tentação do Anel, que Tolkien retrata de forma única para cada personagem, refletindo seus desejos e temores mais profundos; e exercer real discernimento moral sobre o uso do poder (vs. calcular probabilisticamente quais ações são tipicamente consideradas “boas” ou “más” no contexto da narrativa).

Este exemplo do Anel ilustra como as limitações dos sistemas estatísticos de IA não são apenas técnicas, mas profundamente conceituais. Elas são permeadas por questões de causalidade, abstração, subjetividade e agência moral que vão muito além da mera capacidade de reconhecimento de padrões.

Da dimensão emocional

Em que medida podemos conceber uma superinteligência sem componente emocional? Esta questão é particularmente relevante quando consideramos que a inteligência emocional não é um “extra” na cognição humana, mas parte integral de nossos processos decisórios e nossa capacidade de atribuir significado. Nossas emoções contribuem para como tomamos decisões, atribuímos significado, estabelecemos prioridades e desenvolvemos empatia.

Esta questão se relaciona diretamente com as preocupações de Chomsky sobre a ausência de compreensão ética e moral nos sistemas de IA. Para ele, sem a capacidade de fazer julgamentos éticos genuínos ou compreender as implicações morais de suas ações — capacidades intrinsecamente ligadas à nossa dimensão emocional — os sistemas de IA permanecem fundamentalmente limitados em sua capacidade de emular a inteligência humana em sua totalidade, colocando em cheque a possibilidade de alinhamento.

Uma superinteligência sem esta dimensão seria alienígena em relação à experiência humana. Consideremos novamente O Senhor dos Anéis: quando Frodo oferece o Anel a Galadriel, e ela o recusa, reconhecendo que seu desejo de fazer o bem através do poder do Anel inevitavelmente a corromperia, temos uma complexa interação entre compreensão moral, autoconsciência emocional e decisão ética. Um sistema puramente estatístico pode identificar padrões narrativos sobre poder e corrupção, mas não pode verdadeiramente compreender o peso emocional desta escolha ou a profunda sabedoria em reconhecer os próprios limites morais. Da mesma forma, quando Sam carrega Frodo nas encostas do Monte da Perdição, um modelo de linguagem pode reconhecer isto como um ato de lealdade baseado em padrões textuais similares, mas não pode apreender a profundidade emocional deste momento de sacrifício e amizade.

Da corporificação

Como a necessidade de interação física com o mundo influencia o desenvolvimento de inteligência? A questão da corporificação (embodiment) sugere que a inteligência humana é necessariamente baseada em nossa experiência como seres físicos no mundo. Uma superinteligência precisaria não apenas de capacidade computacional, mas de um sistema integrado de inteligência física/motora tão ou mais sofisticado que o sistema cognitivo.

Esta questão é exemplificada de forma particularmente rica na jornada através da Terra-Média. Quando Tolkien descreve a exaustão dos hobbits atravessando os Pântanos Mortos, escalando as escadarias de Cirith Ungol, ou nos últimos passos rumo ao Monte da Perdição, um modelo de linguagem pode processar estas descrições como padrões textuais associados à dificuldade e ao esforço físico. No entanto, sem jamais ter experimentado o peso real de uma mochila, o cansaço de uma longa caminhada, ou a sensação física do frio e da fome, o sistema não pode verdadeiramente compreender a dimensão corpórea desta jornada. Esta experiência corporificada é fundamental não apenas para entender a magnitude do desafio físico, mas também para apreender como estas provações físicas se entrelaçam com o desenvolvimento emocional e moral dos personagens.

Dos limites materiais

A questão da corporificação nos leva naturalmente a considerar desafios ainda mais fundamentais: os limites materiais para a existência de uma superinteligência verdadeiramente autônoma e para a singularidade. Se a experiência física é crucial para o desenvolvimento da inteligência, quais seriam os requisitos materiais para um sistema não apenas cognitivamente avançado, mas capaz de persistir e evoluir de forma independente? Isto extrapola uma questão computacional: toca em aspectos fundamentais de viabilidade material e transcende questões de corporificação para cognição. Trata-se da viabilidade material de uma superinteligência autônoma e auto-evolutiva.

Os limites físicos não são apenas desafios a serem superados, mas potencialmente barreiras intransponíveis para o tipo de superinteligência imaginada por Vinge e Good. Estes autores conceberam um cenário em que uma IA suficientemente avançada seria capaz de melhorar seu próprio design, iniciando um ciclo de autoaperfeiçoamento recursivo: cada versão melhorada seria mais capaz de criar uma versão ainda melhor, levando a uma “explosão de inteligência” que rapidamente ultrapassaria qualquer limite humano concebível. Entretanto, para se autoperpetuar, tal sistema precisaria: projetar e fabricar seus próprios componentes; gerenciar toda cadeia logística de materiais; controlar sistemas de geração e distribuição de energia; manter e reparar infraestrutura física; e coordenar sistemas robóticos para todas essas tarefas.

Esta questão da viabilidade material encontra uma interessante, ainda que imperfeita, analogia em O Senhor dos Anéis através da industrialização de Isengard por Saruman. O mago branco, em sua busca por poder através do desenvolvimento tecnológico, precisa não apenas do conhecimento (sua “inteligência”), mas também de uma vasta infraestrutura material: fornalhas para forjar armas, sistemas para extrair recursos naturais, cadeias de suprimentos para alimentar seu exército. O eventual fracasso de Saruman ilustra, ainda que alegoricamente, como o poder puramente intelectual, sem uma base material sustentável, pode ser ilusório. Da mesma forma, uma superinteligência artificial precisaria não apenas de capacidade computacional, mas de uma complexa infraestrutura física autossustentável para além do processamento de informação.

Autocrítica ao antropocentrismo desta análise

Nossas reflexões indicam que o caminho para uma verdadeira superinteligência pode ser fundamentalmente diferente da evolução incremental dos atuais modelos estatísticos. A análise das limitações conceituais, materiais e cognitivas atuais sugere uma postura simultaneamente mais crítica e mais aberta quanto às possibilidades futuras da inteligência artificial.

Existiria um caminho evolutivo plausível entre inteligência estatística e compreensão genuína? Esta questão transcende a simples escala computacional. Mesmo que um sistema estatístico alcance níveis impressionantes de desempenho em testes como ARC (Abstraction and Reasoning Corpus, desenvolvido por Chollet para avaliar a capacidade de sistemas de IA em identificar e aplicar padrões abstratos), existe uma barreira qualitativa fundamental entre uma inteligência baseada em correlações estatísticas e aquela capaz de compreensão genuína, abstração e causalidade.

A questão pode ser reformulada: não importa quão complexo seja um sistema de equações diferenciais modelando um cérebro, ele poderia em algum momento “gerar” consciência? Este é o cerne do debate sobre a possibilidade de um “salto quântico”, disruptivo, na evolução da IA. Se identificamos barreiras aparentemente intransponíveis entre processamento estatístico e compreensão genuína, também precisamos questionar a adequação de nossas ferramentas conceituais para compreender o que está além do horizonte da singularidade.

As críticas apresentadas podem ser contestadas por uma perspectiva mais radical da superinteligência e singularidade tecnológica. Nossa análise pode estar excessivamente ancorada em uma visão pré-singularidade. Como Meira astutamente aponta em seu texto original, existe um “horizonte de eventos” além do qual nossas próprias categorias conceituais podem se tornar obsoletas. Assim, questões sobre compreensão estatística, corporificação ou a relevância das emoções poderiam se revelar irrelevantes em um cenário pós-singularidade.

A própria distinção entre processamento “estatístico” e “compreensão genuína” ilustra esta limitação conceitual. Esta dicotomia pressupõe uma separação fundamental entre correlação e causalidade, entre padrão e significado. No entanto, uma superinteligência poderia operar em um regime onde esta distinção perde sentido — assim como a distinção clássica entre onda e partícula se dissolveu com o advento da mecânica quântica. Tal como o comportamento quântico transcende nossa intuição sobre a matéria, uma superinteligência poderia desenvolver cognição além de nossa atual dicotomia.

Esta análise revela outro ponto crucial: nosso possível antropocentrismo. A insistência em elementos como emoção, corporificação e compreensão genuína pode refletir mais nossas limitações conceituais do que restrições objetivas ao desenvolvimento de uma superinteligência. Uma inteligência verdadeiramente superior transcenderia nossas categorias atuais de análise.

Mesmo os limites materiais e físicos que identificamos podem subestimar o potencial transformador. Um sistema superior poderia descobrir novas leis físicas ou desenvolver formas de manipulação de energia e matéria que superariam nossas limitações atuais. A própria noção de autonomia física pode ser restritiva — pois um sistema superinteligente poderia emergir, como argumenta Meira, como rede distribuída ao invés de entidade física discreta.

Esta transcendência física não é mera especulação. Assim como a teoria da relatividade revelou que massa e energia são manifestações diferentes do mesmo fenômeno fundamental — algo inconcebível dentro da física newtoniana — uma superinteligência poderia revelar que processamento de informação e manipulação física são aspectos de uma realidade mais fundamental que nossa atual distinção entre “software” e “hardware” não consegue capturar.

Estas considerações não invalidam os pontos anteriores, mas nos convidam a uma postura de maior humildade epistemológica ao considerar o desenvolvimento da inteligência artificial. O desafio é equilibrar o rigor analítico necessário para avançar nossa compreensão atual com a abertura às possibilidades que transcendem nossas categorias atuais de pensamento.

-

Escrevi a íntegra deste texto — em bem mais de uma hora — a partir da leitura do artigo de Meira, com o concurso de IAs em Claude.ai e ChatGPT. O ponto de partida foram três questões que a leitura me suscitou: modelos estatísticos são inteligentes? E a inteligência emocional? E a inteligência física? ↩︎